Comprendre les minima locaux dans la formation sur les réseaux neuronaux

Cet article traite d'une complication qui peut empêcher votre Perceptron d'atteindre une précision de classification adéquate.

Dans la série des réseaux de neurones AAC, nous avons couvert un large éventail de sujets liés à la compréhension et au développement des réseaux de neurones Perceptron multicouches. Avant de lire cet article sur les minima locaux, découvrez le reste de la série ci-dessous :

- Comment effectuer une classification à l'aide d'un réseau de neurones :qu'est-ce que le perceptron ?

- Comment utiliser un exemple simple de réseau neuronal Perceptron pour classer des données

- Comment former un réseau de neurones Perceptron de base

- Comprendre la formation simple sur les réseaux neuronaux

- Une introduction à la théorie de la formation pour les réseaux de neurones

- Comprendre le taux d'apprentissage dans les réseaux de neurones

- Apprentissage automatique avancé avec le Perceptron multicouche

- La fonction d'activation sigmoïde :activation dans les réseaux de neurones Perceptron multicouches

- Comment former un réseau de neurones Perceptron multicouches

- Comprendre les formules d'entraînement et la rétropropagation pour les perceptrons multicouches

- Architecture de réseau neuronal pour une implémentation Python

- Comment créer un réseau de neurones Perceptron multicouche en Python

- Traitement du signal à l'aide de réseaux de neurones :validation dans la conception de réseaux de neurones

- Entraînement d'ensembles de données pour les réseaux de neurones :comment entraîner et valider un réseau de neurones Python

- De combien de couches et de nœuds cachés un réseau de neurones a-t-il besoin ?

- Comment augmenter la précision d'un réseau de neurones à couche cachée

- Incorporer des nœuds de polarisation dans votre réseau de neurones

- Comprendre les minima locaux dans la formation sur les réseaux neuronaux

La formation en réseau de neurones est un processus complexe. Heureusement, nous n'avons pas besoin de le comprendre parfaitement pour en bénéficier :les architectures de réseau et les procédures de formation que nous utilisons aboutissent réellement à des systèmes fonctionnels qui atteignent une très grande précision de classification. Cependant, il y a un aspect théorique de la formation qui, bien que quelque peu abscons, mérite notre attention.

Nous l'appellerons « le problème des minima locaux ».

Pourquoi les minima locaux méritent-ils notre attention ?

Eh bien… je ne suis pas sûr. Lorsque j'ai découvert les réseaux de neurones pour la première fois, j'ai eu l'impression que les minima locaux sont vraiment un obstacle important à une formation réussie, du moins lorsque nous avons affaire à des relations entrées-sorties complexes. Cependant, je crois que les recherches récentes minimisent l'importance des minima locaux. Peut-être que des structures de réseau et des techniques de traitement plus récentes ont atténué la gravité du problème, ou peut-être avons-nous simplement une meilleure compréhension de la façon dont les réseaux de neurones naviguent réellement vers la solution souhaitée.

Nous reviendrons sur l'état actuel des minima locaux à la fin de cet article. Pour l'instant, je vais répondre à ma question comme suit :ou au moins étaient —considéré comme un obstacle important à la mise en œuvre réussie des réseaux de neurones dans des systèmes réels.

Qu'est-ce qu'un minimum local ?

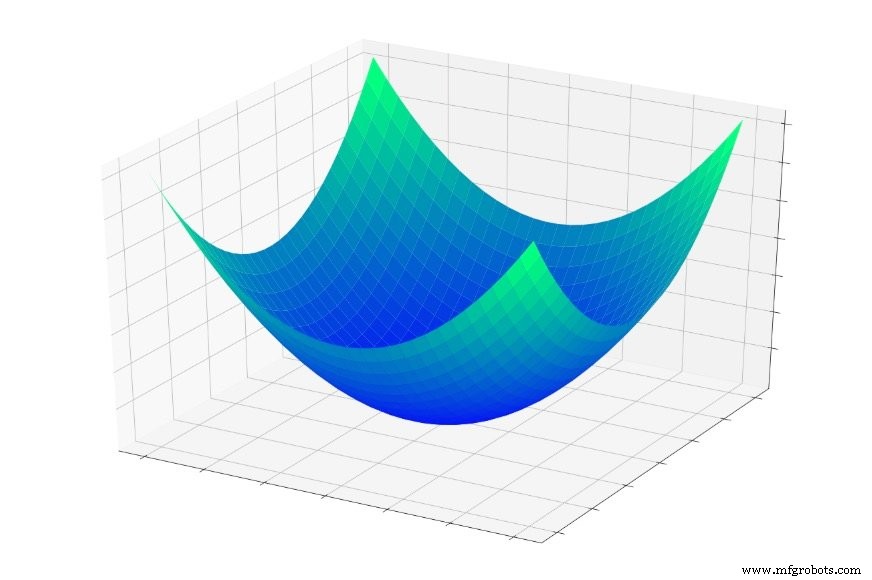

Dans la partie 5, nous avons considéré le « bol d'erreur » illustré ci-dessous, et j'ai décrit l'entraînement comme étant essentiellement une quête du point le plus bas dans ce bol.

(Remarque :Tout au long de cet article, mes images et explications s'appuieront sur notre compréhension intuitive des structures tridimensionnelles, mais gardez à l'esprit que les concepts généraux ne se limitent pas aux relations tridimensionnelles. En effet, nous utilisons fréquemment des réseaux de neurones dont la dimensionnalité dépasse de loin deux variables d'entrée et une variable de sortie.)

Si vous deviez sauter dans ce bol, vous glisseriez vers le bas, à chaque fois. Peu importe où vous commencez , vous vous retrouverez au point le plus bas de toute la fonction d'erreur. Ce point le plus bas est le minimum global . Lorsqu'un réseau a convergé vers le minimum global, il a optimisé sa capacité à classer les données d'apprentissage, et en théorie , c'est l'objectif fondamental de l'entraînement :continuer à modifier les poids jusqu'à ce que le minimum global soit atteint.

Nous savons cependant que les réseaux de neurones sont capables d'approcher des relations entrées-sorties extrêmement complexes. Le bol d'erreur ci-dessus ne correspond pas exactement à la catégorie « extrêmement complexe ». C'est simplement un tracé de la fonction \(f(x,y) =x^2 + y^2\).

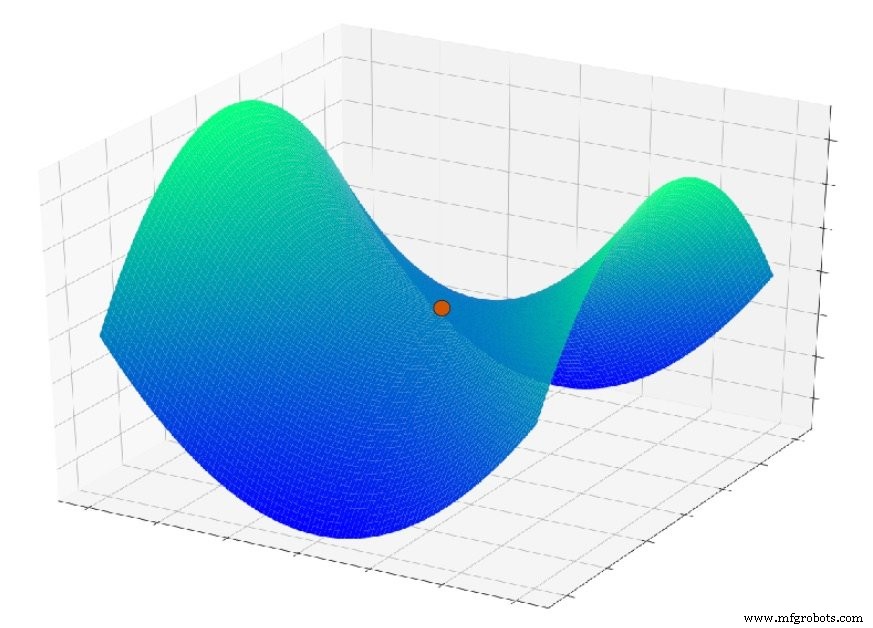

Mais imaginez maintenant que la fonction d'erreur ressemble à ceci :

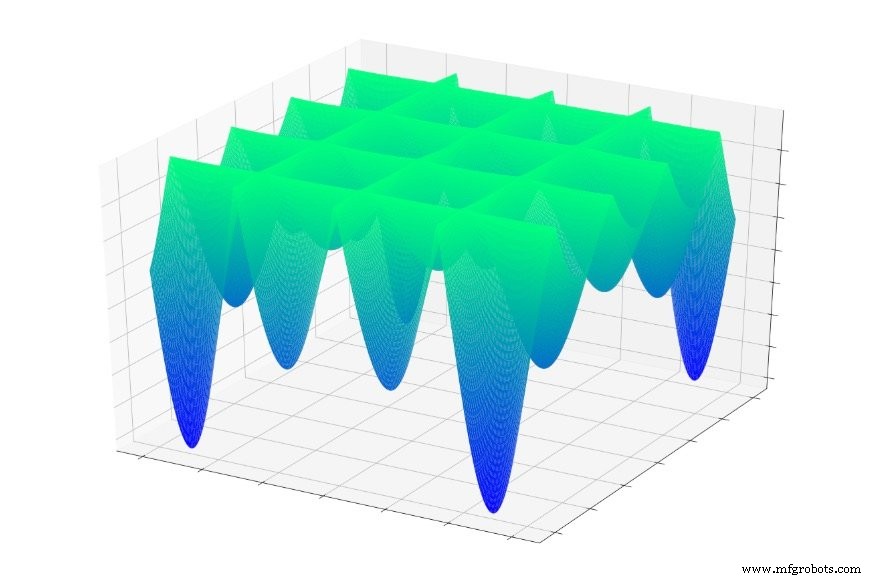

Ou ceci :

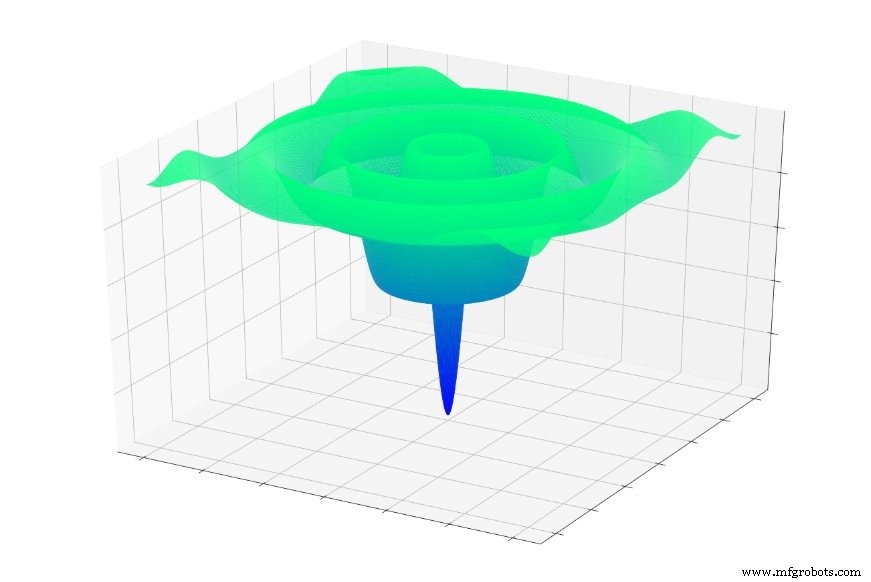

Ou ceci :

Si vous sautiez au hasard dans l'une de ces fonctions, vous glisseriez souvent vers un minimum local. Vous seriez au point le plus bas d'une partie localisée du graphique, mais vous pourriez être loin du global minimum.

La même chose peut arriver à un réseau de neurones. La descente de gradient repose sur local des informations qui, nous l'espérons, mèneront un réseau vers le mondial le minimum. Le réseau n'a aucune connaissance préalable des caractéristiques de la surface d'erreur globale, et par conséquent lorsqu'il atteint un point qui semble être le bas de la surface d'erreur sur la base d'informations locales , il ne peut pas extraire une carte topographique et déterminer qu'il doit remonter la pente afin de trouver le point qui est réellement inférieur à tous les autres.

Lorsque nous implémentons une descente de gradient de base, nous disons au réseau :« Trouvez le fond d'une surface d'erreur et restez-y ». Nous ne disons pas :« Trouvez le fond d'une surface d'erreur, notez vos coordonnées, puis continuez à monter et à descendre jusqu'à ce que vous trouviez la suivante. Faites-moi savoir quand vous avez terminé."

Voulons-nous vraiment trouver le minimum global ?

Il est raisonnable de supposer que le minimum global représente la solution optimale, et de conclure que les minimums locaux sont problématiques car l'entraînement pourrait "s'arrêter" dans un minimum local plutôt que de continuer vers le minimum global.

Je pense que cette hypothèse est valable dans de nombreux cas, mais des recherches assez récentes sur les surfaces de perte de réseau neuronal suggèrent que les réseaux à haute complexité peuvent en fait bénéficier des minima locaux, car un réseau qui trouve le minimum global sera surentraîné et sera donc moins efficace lors du traitement de nouveaux échantillons d'entrée.

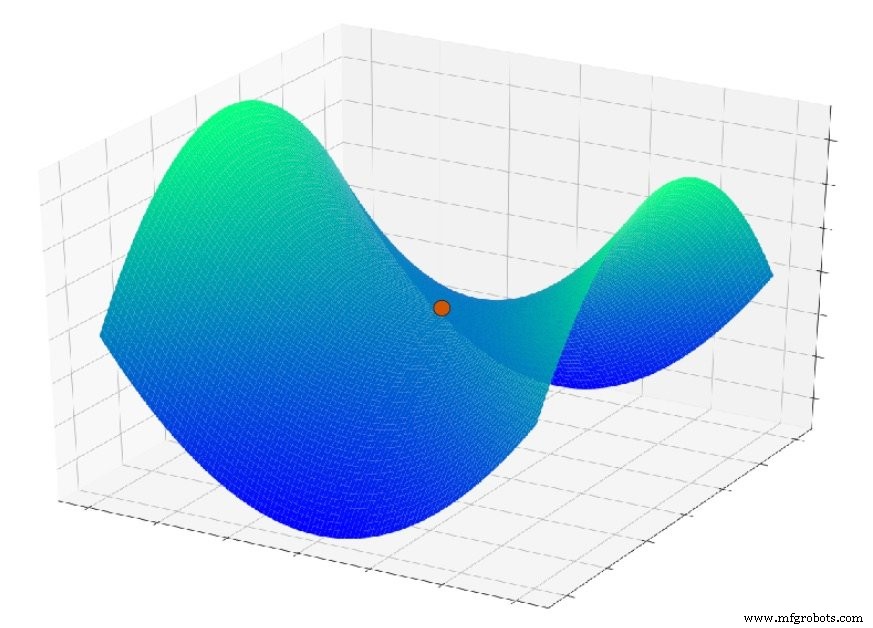

Un autre problème qui entre en jeu ici est une caractéristique de surface appelée point de selle ; vous pouvez voir un exemple dans l'intrigue ci-dessous. Il est possible que dans le contexte de véritables applications de réseau de neurones, les points de selle dans la surface d'erreur soient en fait une préoccupation plus sérieuse que les minima locaux.

Conclusion

J'espère que vous avez apprécié cette discussion sur les minima locaux. Dans le prochain article, nous discuterons de certaines techniques qui aident un réseau de neurones à atteindre le minimum global (si c'est effectivement ce que nous voulons qu'il fasse).

Robot industriel

- Topologie du réseau

- Protocoles réseau

- ST pilote l'IA vers les périphériques embarqués de périphérie et de nœud avec la boîte à outils de développement de réseau neuronal STM32

- CEVA :processeur IA de deuxième génération pour les charges de travail des réseaux de neurones profonds

- Incorporation de nœuds de polarisation dans votre réseau neuronal

- Le réseau neuronal artificiel peut améliorer la communication sans fil

- L'entraînement d'un grand réseau de neurones peut émettre 284 000 kilo de CO2

- Comprendre la découpe laser à fibre robotique par rapport à la découpe plasma

- Récupération de données :le modèle de réseau neuronal du NIST trouve de petits objets dans des images denses