Technologie de caméra mégapixel à comptage de photons

Imaginez un appareil photo conçu pour capturer des images avec une résolution d'un seul photon à 24 000 images par seconde. Grâce à un obturateur électronique qui ne peut rester ouvert que 3,8 ns et qui peut être synchronisé avec des impulsions laser rapides d'une durée de quelques picosecondes seulement, on peut littéralement voir la lumière se propager dans l'espace. Grâce à cette capacité, de nouvelles applications s'ouvrent telles que la vision quantique, l'imagerie fantôme, l'imagerie du bruit de sous-coup, le LiDAR quantique et la distillation quantique, pour n'en nommer que quelques-unes.

Le point commun à ces applications est le besoin d'une détection à photon unique et d'une résolution temporelle élevée avec un faible bruit et une sensibilité élevée. Cette nouvelle caméra est capable de tout cela mais, en plus, elle le fait sur un million de pixels simultanément, permettant ainsi une accélération considérable en capture et, éventuellement, en reconstruction. Au cœur de ces pixels se trouve une diode à avalanche à photon unique (SPAD) qui effectue la détection des photons, générant une impulsion numérique. Cette impulsion peut être comptée ou horodatée, donnant ainsi le comptage de photons et le caractère résolu en temps de la caméra.

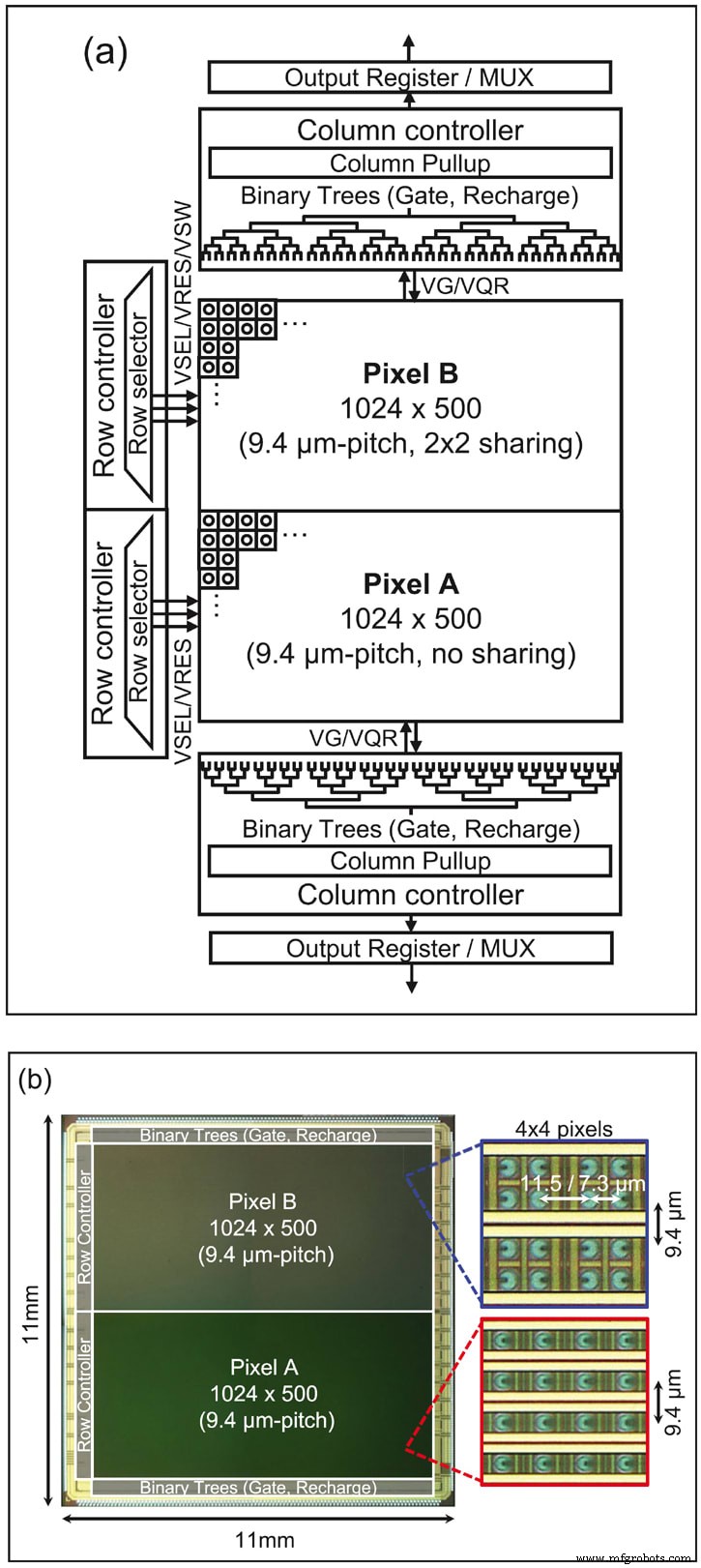

Dans un article publié dans la revue à comité de lecture Optica, nous avons présenté le premier appareil photo 1 Mpixel basé sur les pixels SPAD. Les pixels ont un pas de 9,4 µm, avec une architecture 7T (7 transistors par pixel) ou 5,75T. La micrographie de la puce de la caméra est illustrée à la figure 1(b). Le schéma fonctionnel de la caméra est illustré à la figure 1(a); il comprend un double arbre binaire pour commander l'obturateur avec une précision d'environ 100ps et une position réglable par pas de 36ps. Cela permet de reconstruire des images 3D en mesurant le temps de vol d'une impulsion lumineuse lorsqu'elle quitte le laser et est réfléchie par un objet. Il permet également de capturer la lumière en vol, exposant ainsi des effets relativistes intéressants en laboratoire.

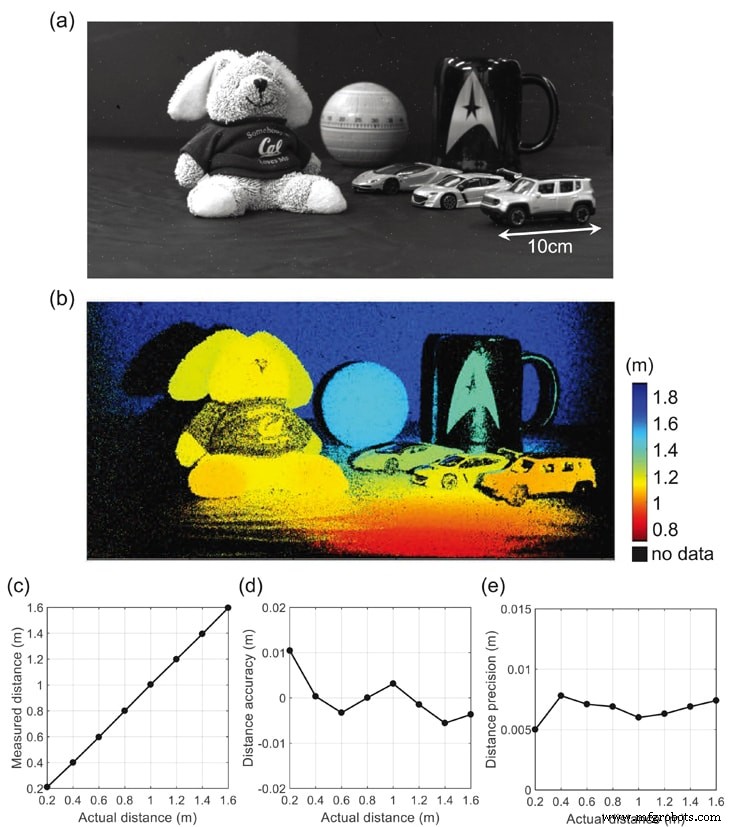

La puce a été testée en tant que capteur d'image d'intensité avec un graphique standard (Figure 2 (a)) jusqu'à 14 bits au niveau des pixels. Les figures 3 (a) et (b) montrent des images 2D et 3D à code couleur obtenues en éclairant une scène avec un laser à 637 nm pulsé à 40 MHz et capturées sur le capteur d'image à demi-résolution. La fenêtre de porte avec sa longueur de 3,8 ns est décalée de 0,6 ns à 13,2 ns par pas de 36 ps pour acquérir des profils d'intensité de photons complets en fonction de la position de la porte.

La distance LSB dans cette mesure correspond à 5,4 mm. Les informations de profondeur sont reconstruites en détectant la position du front montant du profil d'intensité lissé pour chaque pixel, correspondant au temps d'arrivée de l'impulsion laser réfléchie. Le décalage de synchronisation de porte sur le réseau est compensé en soustrayant la distribution de décalage de synchronisation mesurée indépendamment de la distribution de temps d'arrivée mesurée. Dans la figure 3 (b), la couleur rouge indique une plus grande proximité avec la caméra SPAD, tandis que la couleur bleue correspond à une distance plus élevée. La plage de profondeur maximale pour cette mesure a été fixée à 2 m, mais elle peut être étendue à des dizaines de mètres en abaissant la fréquence de répétition du laser et en augmentant le pas de porte.

Le pas de balayage de la porte fine et la longue exposition sont utilisés pour obtenir une précision de profondeur élevée, et le temps d'acquisition de données résultant pour cette mesure était de quelques dizaines de secondes. Ceci est considérablement plus long que celui d'autres méthodes de télémétrie telles que le temps de vol indirect, mais il peut être facilement réduit en augmentant le pas de balayage de la porte, en réduisant la plage de balayage et en augmentant la puissance laser pour réduire le temps d'exposition. De plus, une amélioration supplémentaire est attendue en mettant en œuvre une microlentille sur puce pour augmenter la sensibilité.

La figure 3(c) montre la distance mesurée en fonction de la distance réelle de l'objet. Dans la figure 3 (c), (d) et (e), un objet plat recouvert de papier blanc (réflectance d'environ 60 %) est utilisé pour évaluer la distance, l'exactitude et la précision mesurées. Dans la figure 3 (c), la distance mesurée est extraite en prenant la moyenne de la distance d'un seul pixel sur 20 × 20 pixels au centre du réseau. Un très bon accord avec la distance réelle est observé dans la plage mesurée de 0,2 à 1,6 m. Dans la figure 3(d), la précision de la distance est calculée comme la distance mesurée moyenne soustraite de la distance réelle. Pour la plage de distance mesurée, la précision est toujours meilleure que 1 cm. Dans la figure 3 (e), la précision de la distance est exploitée comme un écart type de la distance d'un seul pixel sur 20 × 20 pixels au centre du réseau. La précision est meilleure que 7,8 mm (rms) pour tous les points mesurés jusqu'à 1,6 m.

La détection multi-objets a été démontrée expérimentalement en codant l'illumination temporelle ou les modèles d'exposition, ce qui implique un coût de calcul important pour récupérer des images 3D. Un capteur de temps de vol temporisé fournit une solution alternative et évolutive au moyen d'un circuit de pixels compact et d'un calcul moins compliqué.

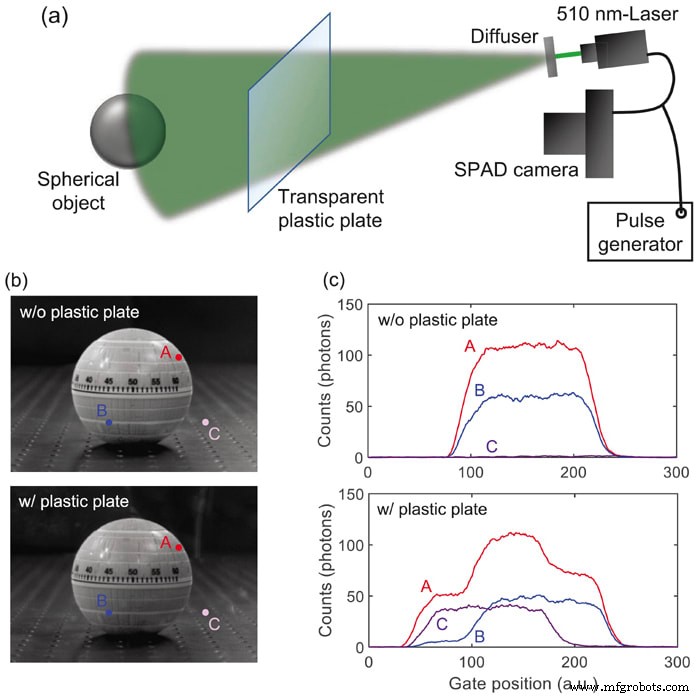

La figure 4(a) montre la configuration expérimentale :un faisceau laser de 510 nm pulsé à 40 MHz est diffusé par un diffuseur et utilisé pour éclairer une cible sphérique. La caméra SPAD est synchronisée avec le signal de déclenchement du laser et une plaque en plastique transparent est insérée entre la caméra et l'objet. Les distances entre la caméra et la plaque en plastique et l'objet sont respectivement de 0,45 m et 0,75 m. La figure 4 (b) montre des images d'intensité 2D sous un éclairage intérieur avec et sans la plaque en plastique insérée. La plaque étant presque transparente, aucune différence significative n'est observée dans les images 2D pour ces deux cas.

Les profils de synchronisation mesurés pour trois points représentatifs (A, B et C) sont tracés à la figure 4 (c). Sans la plaque, les profils de déclenchement temporel pour les points A et B ne montrent qu'une seule forme d'onde de fonction rectangulaire lissée avec son front montant autour de la position de porte 100 (un pas de la position correspondant à 36 ps). Pour le point C, le nombre de photons reste proche de zéro sur la plage de positions de grille mesurée, indiquant qu'aucun objet réfléchissant n'est détecté à ce pixel.

Avec la plaque en plastique, en revanche, le profil au point A montre des fronts montants en deux étapes autour des positions de porte 40 et 100. Étant donné que le profil mesuré du nombre de photons est une convolution d'une seule fonction rectangulaire lissée et de la distribution d'intensité des photons réfléchis, le profil en deux étapes est une preuve convaincante de la double réflexion de la plaque en plastique et de l'objet sphérique. Un comportement similaire est observé au point B, où la pente du premier front montant autour de la position de grille 40 est plus douce que celle du point A. Le profil au point C ne montre qu'un seul front montant autour de la position de grille 40, correspondant à la réflexion du plastique assiette. La variation de la pente du front montant autour de la position de la porte 40 entre différents points est induite par la réflexion non uniforme de la surface de la plaque en plastique.

Les résultats démontrent la capacité d'une caméra SPAD temporisée à effectuer une détection multi-objets spatialement superposée. A noter que le schéma proposé peut être appliqué à la détection de plus de deux pics de réflexion. Un balayage plus fin de la fenêtre de porte virtuelle en post-traitement permet une détection systématique de plusieurs pics. La distance minimale résoluble entre deux matériaux réfléchissants voisins est fondamentalement limitée par le temps de montée ou de descente fini du profil de la fenêtre de la porte, correspondant à 5-10 cm dans ce capteur SPAD.

En conclusion, un capteur d'image SPAD temporel de 1 Mpixel a été signalé pour la première fois. Dans la recherche SPAD, la réalisation d'un capteur SPAD mégapixel a été considérée comme l'une des étapes les plus importantes depuis plus d'une décennie. Le capteur est appliqué à l'imagerie 2D à plage dynamique élevée et à l'imagerie 3D à haute résolution spatio-temporelle. À notre connaissance, la détection multi-objets spatialement superposée avec un schéma de déclenchement temporel à photon unique a été démontrée expérimentalement pour la première fois.

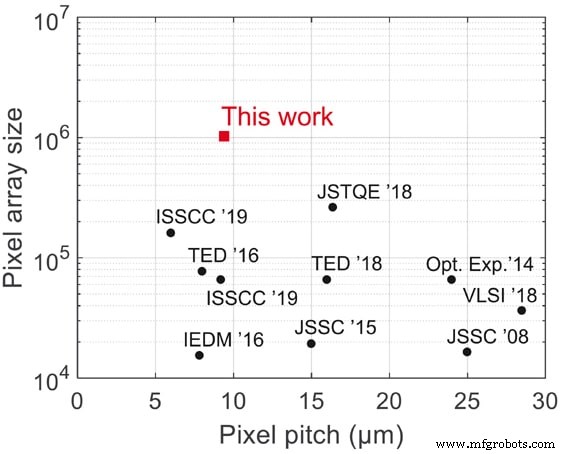

La figure 5 montre une comparaison de pointe du pas de pixel SPAD et de la taille de la matrice. La taille du réseau du capteur est la plus grande, presque 4 fois supérieure à celle du capteur de pointe, tandis que le pas des pixels est l'un des plus petits. Grâce à ses capacités d'imagerie 2D et 3D haute résolution, le capteur proposé sera utile dans une grande variété d'applications industrielles telles que la sécurité, l'automobile, la robotique, les applications biomédicales et scientifiques, y compris l'imagerie quantique et l'imagerie ultra-rapide.

Lire un rapport complet sur la technologie dans la revue scientifique Optica .

Cet article a été rédigé par Edoardo Charbon, Professeur, EPFL Suisse (Lausanne, Suisse). Pour plus d'informations, rendez-vous ici .

Capteur

- Appareil photo

- Investissements dans la technologie de fabrication — Post-pandémie

- Lecteur de livres BrickPi

- Technologie de mouvement linéaire

- Appareil photo sans objectif multi-prises

- Scanner corporel haute définition à ondes millimétriques

- Guide du fournisseur 2021 :Capteurs

- Récupérateur d'énergie thermique sandwich pyroélectrique

- Caméra plénoptique