Les puces d'IA montent en flèche, les logiciels d'IA sont sous le feu des projecteurs

Alors que l'industrie technologique continue de vanter une « renaissance » de intelligence, le nombre de startups de puces d'IA a commencé à plafonner alors que les principaux acteurs construisent des solutions internes et se concentrent sur les logiciels d'IA augmente.

Alors que l'industrie technologique continue de vanter une « renaissance » de l'intelligence artificielle, le nombre de startups de puces IA a commencé à plafonner. Les startups de l'IA constatent que les barrières à l'entrée des centres de données, autrefois un marché prometteur, sont élevées, voire prohibitives. Leur problème provient des hyperscalers tels que Google, Amazon et Facebook qui développent désormais leurs propres processeurs et accélérateurs d'IA qui répondent à leurs besoins spécifiques.

Pour être clair, l'apprentissage automatique (ML) continue de progresser. De plus en plus de variantes de réseaux de neurones apparaissent. L'IA devient intrinsèque à chaque système électronique.

Laurent Moll, directeur des opérations chez Arteris, prédit qu'à l'avenir, "tout le monde aura une sorte d'IA dans ses SoC". C'est une bonne nouvelle pour Arteris, car son activité consiste à aider les entreprises (grandes et petites, ou nouvelles et anciennes) à intégrer des SoC en fournissant des outils de développement IP et IP sur puce (NoC).

Pour les startups de puces AI ? Pas tellement. La concurrence devient rude, ce qui complique le défi de percer des segments de marché adaptés à une conception d'IA particulière.

EE Times dévoilera le mois prochain notre « Silicon 100 » (version 2021), une liste annuelle des startups émergentes de l'électronique et des semi-conducteurs. L'auteur du rapport, Peter Clarke, suit de près les startups de semi-conducteurs depuis deux décennies. Il nous dit que le nombre de startups spécialisées dans les puces, axées sur les GPU et l'IA, "est stable par rapport à l'année précédente". Il observe :« Nous sentons que l'industrie a peut-être atteint le point de" pic de l'IA ". »

En bref, les jours de salade des startups de puces IA sont peut-être révolus.

Kevin Krewell, analyste principal chez Tirias Research, s'attend à davantage d'acquisitions de startups de puces IA. « Après tout, l'explosion du financement des startups de l'IA s'est produite après qu'Intel a acheté Nervana. Les VCs et les anges ont vu une possible stratégie de sortie lucrative. » Il a ajouté qu'il y a « trop de startups [IA] aujourd'hui que l'industrie ne peut supporter à long terme. Je suis sûr que quelques autres apparaîtront avec des solutions plus exotiques impliquant l'analogique ou l'optique. [Mais] à terme, les fonctions AI/ML seront intégrées dans des SoC plus grands ou dans des conceptions de puces. »

Laurent Moll

Dans ce contexte, EE Times a récemment rencontré le nouveau directeur de l'exploitation d'Arteris. Moll, qui était autrefois CTO d'Arteris, a passé plus de sept ans chez Qualcomm, plus récemment en tant que vice-président de l'ingénierie du géant des puces mobiles.

Nous avons interrogé Moll sur les changements dans le paysage des puces d'IA et sur la direction que prennent les startups.

Ruée vers l'or

Sans surprise, Moll a décrit la course de l'industrie vers l'IA comme « l'une des plus grandes ruées vers l'or » qu'il ait jamais vues. Cependant, ces 49ers des derniers jours ne sont plus seulement des startups ou des petites entreprises. Les prospecteurs comprennent des entreprises qui « fabriquent du silicium depuis longtemps et de nombreuses nouvelles personnes qui n'ont pas fabriqué de silicium [before] », a déclaré Moll. Tout le monde « joue dans la même arène » et tout le monde « essaie de casser la noix ».

La base croissante de développeurs et la diversification des applications jouent à l'avantage d'Arteris, mais cela brosse un tableau très différent pour les startups de puces IA. Ils ne rivalisent plus uniquement avec d'autres startups de l'IA avec de nouvelles idées tout aussi brillantes. Mais maintenant, ils affrontent aussi les grands. Les hyperscalers et les constructeurs automobiles se lancent dans le développement de l'IA afin de pouvoir utiliser leurs propres puces pour leurs systèmes.

Toujours en phase d'expansion

Le marché des puces d'IA est "toujours en phase d'expansion" avec "tout le monde est encore en train d'explorer", a observé Moll d'Arteris. Néanmoins, il voit l'émergence d'un « petit peu d'ordre » sur le front des datacenters. C'est en grande partie parce que les hyperscalers prennent leur destin en main en développant leurs propres processeurs et accélérateurs d'IA.

La distinction entre les hyperscalers et les autres concepteurs de puces IA se résume à un facteur. "Ils possèdent des ensembles de données", a déclaré Moll. Les hyperscalers ne partagent pas d'ensembles de données avec d'autres, mais ils développent des piles de logiciels propriétaires. "Et ils sentent qu'ils peuvent créer du silicium, beaucoup plus optimisé pour leur propre accès aux données."

Pendant ce temps, des fournisseurs externes - de plus petites startups de puces AI - "développent de nouvelles méthodes de structuration des SoC, de nouvelles façons d'utiliser la SRAM et la DRAM, l'empilage, l'utilisation de l'optique", a déclaré Moll. « Il existe de nombreuses façons de créer une sauce secrète, leur permettant de faire de l'IA bien mieux que ce que les puces d'IA du commerce peuvent faire aujourd'hui. Les plus petits changent la donne, ils sont très intelligents pour faire les choses différemment des autres. »

En revanche, les puces IA recherchées par les hyperscalers ne sont pas si innovantes. Les hyperscalers peuvent se permettre d'utiliser une approche plus traditionnelle, a observé Moll. Un bon exemple est le TPU de Google. « Si vous le regardez, l'architecture est géniale, mais ce n'est pas révolutionnaire – à bien des égards. » Malgré cela, « Cela fonctionne extrêmement bien pour ce que Google veut faire. Donc, cela sert leur objectif. »

Si les puces des petites startups d'IA sont si nouvelles, ne devraient-elles pas se faufiler dans les centres de données des hyperscalers ?

"Non, non, non", a déclaré Moll. « Il est peu probable que les plus petits se développent sur le marché des centres de données… ou que les hyperscalers achètent leurs produits. » Cependant, il a noté que "les hyperscalers achèteront certainement certaines de ces startups, une fois qu'ils auront vu que leurs technologies sont utiles et applicables à ce qu'ils veulent faire."

Moll a décrit le train de pensées de l'hyperscaler comme suit :« Je sais quel est mon ensemble de données. Je sais faire une sorte d'architecture plus centrée. Si quelqu'un a une idée géniale qui fonctionne bien, saisissons cet ensemble de personnes et l'IP, et améliorons notre propre produit."

Krewell de Tirias Research a accepté. « Vous devez faire quelque chose de spectaculaire pour que les hyperscalaires s'engagent à utiliser votre puce d'apprentissage automatique. » Cerebras, par exemple, a poussé l'enveloppe avec sa puce de la taille d'une plaquette, a déclaré Krewell. « Nvidia est toujours la plate-forme par défaut pour le travail de développement de l'IA en raison de son logiciel omniprésent et de son évolutivité. »

Et le bord ?

Pour les concepteurs de puces IA, « l'avantage est une toute autre histoire », par rapport aux centres de données, a noté Moll. Le marché final de la périphérie est polyvalent, avec un désir d'une gamme beaucoup plus large de solutions. "Beaucoup de gens cherchent encore où appliquer l'IA et comment la mettre en œuvre", a déclaré Moll.

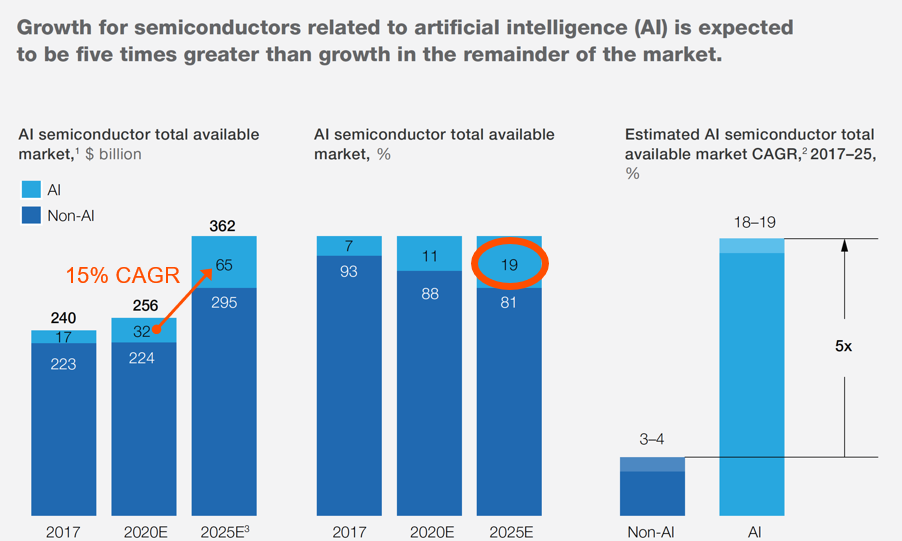

cliquez pour l'image en taille réelle

19 % du marché total des semi-conducteurs disponibles seront liés à l'IA/ML en 2025. (Source :Bernstein ; Cisco ; Gartner ; IC Insights ; IHS Markit ; Machina Research ; McKinsey Analysis — Compilé par Arteris)

Krewell de Tirias Research est d'accord. « Edge est encore un domaine relativement inexploré. Il existe encore des possibilités d'ajouter le ML aux capteurs et aux dispositifs de périphérie. Les appareils analogiques et en mémoire à très faible consommation sont prometteurs, ainsi que les accélérateurs dans les MCU et les processeurs d'applications. Je vois beaucoup de potentiel pour l'inférence INT4 et INT2 dans les processeurs Edge - une bonne précision avec des besoins en énergie et en mémoire beaucoup plus faibles. »

Bien que diverses applications semblent passionnantes, elles comportent le danger de se laisser entraîner dans le cycle de battage médiatique Edge AI.

Edge AI est devenu un mot à la mode non pas parce que Edge est un nouveau marché, ni parce qu'il ne désigne aucune catégorie de produits spécifique. Au contraire, un manque de définition a transformé « edge » en un fourre-tout auquel les startups peuvent associer leurs produits.

Parmi les applications larges, Moll voit deux tendances divergentes. L'un est une "IA à l'intérieur d'une puce qui fait autre chose", a-t-il noté. "C'est là qu'est l'explosion."

Ce marché des systèmes embarqués est « où des éléments tels que les facteurs de forme, la puissance et la température comptent vraiment », a-t-il ajouté.

Une autre tendance à l'autre extrémité du spectre est "d'énormes puces qui ne font que faire de l'IA", a noté Moll. Les applications pour les grosses puces à la périphérie, cependant, continuent d'évoluer.

Le meilleur exemple d'« IA à l'intérieur d'une puce » est probablement celui des processeurs d'applications pour smartphones, que Moll connaît bien. Les accélérateurs d'IA ont joué un rôle clé dans la reconnaissance vocale et le traitement de la vision. Aujourd'hui, l'IA est devenue une grande partie de l'attrait commercial du téléphone portable. L'un des résultats est que « les titulaires du mobile [comme Qualcomm] ont des avantages », a reconnu Moll.

IA dans l'automobile

Moll voit que l'IA dans les véhicules est une toute autre histoire.

Il a noté qu'il y aura un éventail de solutions, des puces de vision par ordinateur à forte IA à une grosse puce d'IA qui effectue tout le traitement lourd. À mesure que les véhicules passent de l'ADAS à l'autonomie, Moll s'attend à ce que des processeurs d'IA plus puissants jouent un rôle essentiel sur le marché des véhicules haut de gamme.

Alors que les opérateurs historiques de l'automobile, souvent armés de leurs propres petites puces d'IA, ont des avantages dans ADAS, il y a amplement de place pour les startups de puces d'IA sur le marché de l'autonomie avec des puces d'IA assez grandes.

Mais voici la torsion.

Les constructeurs automobiles - imitant les hyperscalers - se dirigent également vers la verticale. Tesla a déjà conçu sa propre puce, appelée ordinateur « Full Self-Driving ». Il y a quelques semaines, le PDG de Volkswagen, Herbert Diess, a déclaré à un journal allemand que la société prévoyait de concevoir et de développer ses propres puces haute puissance pour les véhicules autonomes, ainsi que le logiciel requis.

Moll a confirmé que les constructeurs automobiles "examinent tous cela très attentivement". Même si Arteris est une société de propriété intellectuelle, « nous recevons des appels de constructeurs automobiles parce qu'ils veulent comprendre l'ensemble de la pile et qu'ils veulent contrôler » « le gros tas de silicium » qui est sur le point d'entrer et de modifier l'architecture du véhicule .

Les startups de puces d'IA telles que Recogni, Blaize et Mythic classent l'automobile comme un segment de marché de pointe de l'IA qu'elles ciblent. Reste à voir comment les constructeurs automobiles finiront par implémenter de telles puces dans un véhicule.

Krewell a souligné :« Les plateformes automobiles évoluent encore. La fonctionnalité distribuée présente les avantages de la modularité et de la réduction des risques, mais elle est plus coûteuse à construire et à entretenir qu'un complexe de traitement centralisé. »

Il a ajouté :« L'autre problème, ce sont les données. Les capteurs enverront beaucoup de données, l'intelligence à la périphérie réduit les transferts de données, mais au prix d'un décalage accru des capteurs et d'une puissance plus distribuée dans le châssis. Un certain équilibre entre un traitement de bord léger au niveau du capteur pourrait réduire la charge sur le processeur central sans ajouter de latence excessive ou sans nécessiter trop de puissance distribuée. »

La bataille de l'IA passe des puces aux logiciels

Krewell a observé :« Je vois l'orientation de l'IA passer des puces aux logiciels. Le déploiement de la fonctionnalité ML nécessite un bon logiciel. Et pour rendre le ML accessible à davantage d'ingénieurs de conception et de programmeurs embarqués, il faut rendre le ML low-code. Cela nécessite également d'automatiser la création de modèles personnalisés pour l'application spécifique. »

Moll est arrivé à une conclusion similaire. Lorsqu'on lui a demandé pourquoi il avait décidé de revenir de Qualcomm chez Arteris, il a cité deux points.

Tout d'abord, l'Arteris jouait dans une niche - "une place étroite entre les fournisseurs d'IP". Mais ce créneau est maintenant devenu « l'un des espaces clés » où les concepteurs de puces IA recherchent de l'aide pour « assembler des SoC très volumineux et compliqués » en construisant de nombreux réseaux sur puces. C'est là qu'un réseau sur puce (NOC) d'Arteris peut intervenir pour résoudre les problèmes de manière holistique.

Deuxièmement, Arteris IP a acquis Magillem l'année dernière. Moll considère la « couche logicielle » offerte par Magillem comme une autre clé pour créer un SoC très volumineux et compliqué. Ayant été responsable chez Qualcomm de l'équipe fournissant des puces de haut niveau, « J'en suis venu à reconnaître la valeur de ce qu'Arteris propose en tant qu'utilisateur, pas en tant que spécialiste du marketing. »

>> Cet article a été initialement publié sur notre site frère, EE Fois.

Technologie de l'Internet des objets

- Mises à jour logicielles dans l'IoT :une introduction à SOTA

- La version 9.0 du logiciel Bosch IoT Gateway est maintenant disponible

- GE va lancer une société IIoT de 1,2 milliard de dollars

- Arm crée des puces IoT virtuelles pour accélérer le développement

- Tout devient IoT

- Shadow IT :Prendre le contrôle d'un univers parallèle

- Software AG prévoit l'avenir de l'IoT

- Dans le domaine industriel, un logiciel digne de confiance rime avec sécurité

- Tata vante les avantages de l'IIoT